Produto de matrices

En matemáticas, particularmente en álxebra lineal, a multiplicación de matrices é unha operación binaria que produce unha matriz a partir de dúas matrices. Para a multiplicación de matrices, o número de columnas da primeira matriz debe ser igual ao número de filas da segunda matriz. A matriz resultante, coñecida como produto matricial, ten o número de filas da primeira e o número de columnas da segunda matriz. O produto das matrices A e B denotase como AB.[1]

O cálculo de produtos matriciales é unha operación central en todas as aplicacións computacionais da álxebra lineal.

Definicións

[editar | editar a fonte]Produto de matrices

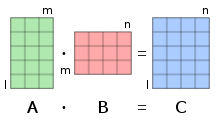

[editar | editar a fonte]Se A é unha matriz m × n e B é unha matriz n × p, o produto matricial C = AB (indicado sen signos ou puntos de multiplicación) defínese como a matriz m × p[2][3][4][5]

- tal que

- para i = 1, ..., m; i = 1, ..., m e j = 1, ..., p j = 1, ..., p.

É dicir, o elemento c_{ij} do produto obtense multiplicando termo por termo as entradas da i-ésima fila de A e a j-ésima columna de B, e sumando estes n produtos. Noutras palabras, c_{ij} é o produto escalar da i-ésima fila de A e a j-ésima columna de B.

Por tanto, o produto AB defínese se e só se o número de columnas en A é igual ao número de filas en B,[1] neste caso n.

A figura seguinte mostra como calcular os coeficientes e da matriz produto se é unha matriz de tipo , et é unha matriz de tipo .

Exemplos

[editar | editar a fonte]- .

En xeral, o produto des matrices non é conmutativa, Isto é, non é igual a , como mostra o seguinte exemplo:

- ,

- mentres que,

Produto escalar

[editar | editar a fonte]O produto escalar de dous vectores e de igual lonxitude é igual a un elemento único (sería unha matriz ) resultante de multiplicar estes vectores como un vector fila por un vector columna, así: (ou ).

O produto escalar dos dous vectores

- e

calcúlase como

- .

Aplicacións fundamentais

[editar | editar a fonte]Historicamente, a multiplicación matricial foi introducida para facilitar e aclarar os cálculos en álxebra linear.

Mapas lineares

[editar | editar a fonte]Un mapa linear A dun espazo vectorial de dimensión n nun espazo vectorial de dimensión m mapea un vector columna

sobre o vector columna

O mapa linear A está así definido pola matriz

e mapea o vector columna no produto matricial

Rotacións xeométricas

[editar | editar a fonte]Usando un sistema de coordenadas cartesianas nun plano euclidiano, a rotación dun ángulo arredor da orixe é un mapa linear. Máis precisamente,

onde o punto de orixe e a súa imaxe escríbense como vectores columna.

Sistema de ecuacións lineares

[editar | editar a fonte]A forma xeral dun sistema de ecuacións lineares é

Usando a mesma notación anterior, tal sistema é equivalente á ecuación matricial única

Produto escalar, forma bilinear e forma sesquilinear

[editar | editar a fonte]O produto escalar de dous vectores columna é o único elemento do produto matricial

onde é o vector fila obtido mediante a transposición de .

Máis xeralmente, calquera forma bilinear sobre un espazo vectorial de dimensión finita pode expresarse como un produto matricial

e calquera forma sesquilinear pode expresarse como

onde denota a transposta conxugada de (conxugada da transposta, ou equivalentemente transposta da conxugada).

Multiplicación matricial por bloque

[editar | editar a fonte]Se consideramos as matrices e , onde e son matrices que verifican:

- O número de columnas en e é igual ao número de filas en e

- O número de columnas en e é igual ao número de filas en e

entón temos a igualdade

Observe a analoxía entre o produto da matriz de bloques e o produto de dúas matrices cadradas de orde 2. por tanto isto non define unha nova forma de produto de matrices. Este é simplemente un método de cálculo de produto matricial común que pode simplificar os cálculos.

Produto de Hadamard

[editar | editar a fonte]- Artigo principal: Produto de Hadamard.

Para dúas matrices do mesmo tipo, temos o "produto Hadamard" ou produto compoñente por compoñente. O produto de Hadamard de dúas matrices e de tipo , denotado A · B = (cij) , é unha matriz de tipo dada por

Por exemplo:

Este produto é unha submatriz do produto de Kronecker.

Produto de Kronecker

[editar | editar a fonte]- Artigo principal: Produto de Kronecker.

Para dúas matrices arbitrarias e , temos o produto tensor ou produto de Kronecker A ⊗ B que se define por

Se é unha matriz de tipo e é unha matriz de tipo daquela A ⊗ B é unha matriz de tipo . De novo esta multiplicación non é conmutativa.

Por exemplo

- .

Se e son as matrices de mapas lineares V1 → W 1 e V2 → W2, respectivamente, logo A ⊗ B representa o produto tensor dos dous mapas, V1 ⊗ V2 → W1 ⊗ W2.

Propiedades comúns

[editar | editar a fonte]Os tres produtos de matrices anteriores, e tamén o produto común de matrices, son asociativos

- ,

distributivos en relación coa suma:

e compatíbeis coa multiplicación por un escalar:

Multiplicación por un escalar

[editar | editar a fonte]O produto por un escalar dunha matriz dá o resultado

- .

Se estamos a traballar con matrices nun anel, a multiplicación por un escalar ás veces chámase "multiplicación á esquerda" mentres que "multiplicación á dereita" defínese por:

- .

Cando o anel é un anel conmutativo, por exemplo, o corpo dos reais ou dos complexos, as dúas multiplicacións son idénticas.

Porén, se o anel non é conmutativo, como o dos quaternións, entón poden ser diferentes. Por exemplo

Outros tipos de produto de matrices

[editar | editar a fonte]Outros tipos de produtos de matrices, a maiores dos xa vistos, inclúen:

- Produto cracoviano, definido como A ∧ B = BTA

- Produto interno de Frobenius, o produto escalar das matrices consideradas vectores ou, equivalentemente, a suma das entradas do produto de Hadamard

- Produto Khatri-Rao e produto Face-splitting

- Produto exterior, tamén chamado produto diádico ou produto tensor de matrices de dúas columnas, que é

Notas

[editar | editar a fonte]- ↑ 1,0 1,1 "matrix vector multiplication". Math Insight.

- ↑ Lipschutz, S.; Lipson, M. (2009). Linear Algebra. Schaum's Outlines (4th ed.). McGraw Hill (USA). pp. 30–31. ISBN 978-0-07-154352-1.

- ↑ Riley, K. F.; Hobson, M. P.; Bence, S. J. (2010). Mathematical methods for physics and engineering. Cambridge University Press. ISBN 978-0-521-86153-3.

- ↑ Adams, R. A. (1995). Calculus, A Complete Course (3rd ed.). Addison Wesley. p. 627. ISBN 0-201-82823-5.

- ↑ Horn, Johnson (2013). Matrix Analysis (2nd ed.). Cambridge University Press. p. 6. ISBN 978-0-521-54823-6.

Véxase tamén

[editar | editar a fonte]| Wikimedia Commons ten máis contidos multimedia na categoría: Produto de matrices |

Bibliografía

[editar | editar a fonte]- Henry Cohn, Robert Kleinberg, Balázs Szegedy, and Chris Umans. Group-theoretic Algorithms for Matrix Multiplication. arXiv:math.GR/0511460. Proceedings of the 46th Annual Symposium on Foundations of Computer Science, 23–25 outubro 2005, Pittsburgh, PA, IEEE Computer Society, pp. 379–388.

- Henry Cohn, Chris Umans. A Group-theoretic Approach to Fast Matrix Multiplication. arXiv:math.GR/0307321. Proceedings of the 44th Annual IEEE Symposium on Foundations of Computer Science, 11–14 outubro 2003, Cambridge, MA, IEEE Computer Society, pp. 438–449.

- Coppersmith, D.; Winograd, S. (1990). "Matrix multiplication via arithmetic progressions". J. Symbolic Comput. 9 (3): 251–280. doi:10.1016/s0747-7171(08)80013-2.

- Horn, Roger A.; Johnson, Charles R. (1991). Topics in Matrix Analysis. Cambridge University Press. ISBN 978-0-521-46713-1.

- Knuth, D.E., The Art of Computer Programming Volume 2: Seminumerical Algorithms. Addison-Wesley Professional; 3 edition (novembro 14, 1997). ISBN 978-0-201-89684-8. pp. 501.

- Press, William H.; Flannery, Brian P.; Teukolsky, Saul A.; Vetterling, William T. (2007). Numerical Recipes: The Art of Scientific Computing (3rd ed.). Cambridge University Press. ISBN 978-0-521-88068-8..

- Ran Raz. On the complexity of matrix product. In Proceedings of the thirty-fourth annual ACM symposium on Theory of computing. ACM Press, 2002. doi 10.1145/509907.509932.

- Robinson, Sara, Toward an Optimal Algorithm for Matrix Multiplication, SIAM News 38(9), novembro 2005. PDF

- Strassen, Volker, Gaussian Elimination is not Optimal, Numer. Math. 13, p. 354–356, 1969.

- Styan, George P. H. (1973). Hadamard Products and Multivariate Statistical Analysis (PDF). Linear Algebra and Its Applications 6. pp. 217–240. doi:10.1016/0024-3795(73)90023-2.

- Williams, Virginia Vassilevska (2012-05-19). "Multiplying matrices faster than coppersmith-winograd". Proceedings of the 44th symposium on Theory of Computing - STOC '12. ACM. pp. 887–898. ISBN 9781450312455. doi:10.1145/2213977.2214056.